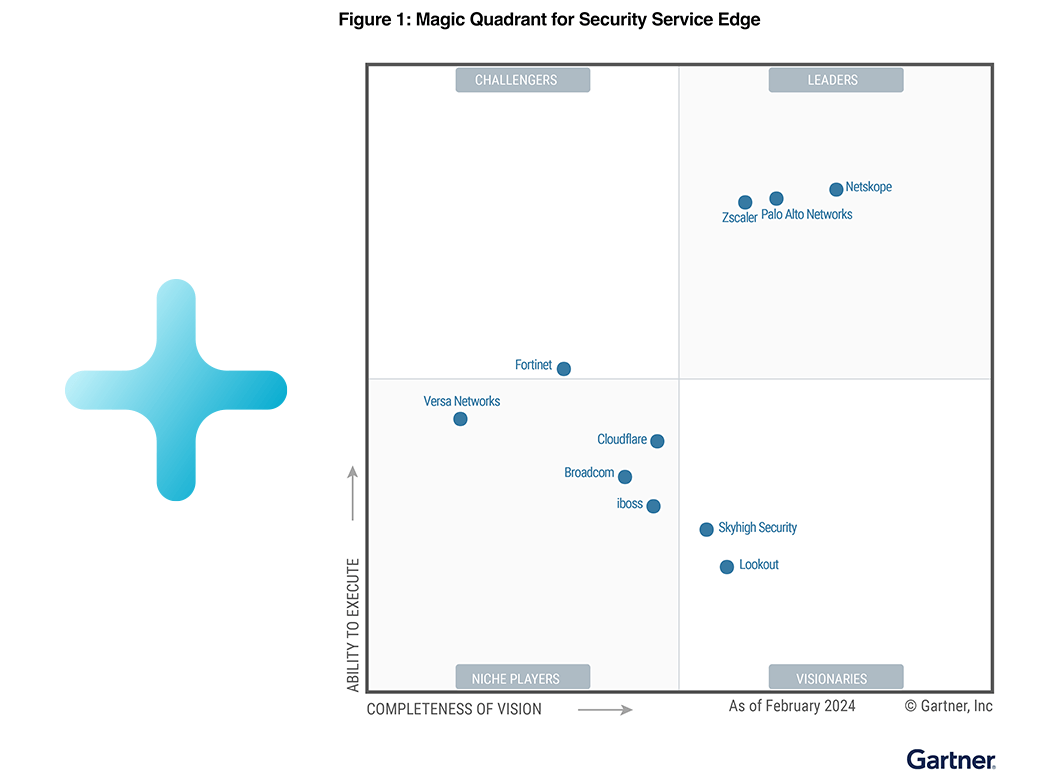

Netskope é nomeada líder no Quadrante Mágico do Gartner® de 2024 para Security Service Edge. Obtenha o Relatório

-

Por que Netskope

- Por que Netskope

Por que Netskope

Mudando a forma como a rede e a segurança trabalham juntas.

Obtenha o RelatórioAinda mais alto em execução.

Ainda mais longe na visão.Saiba por que o 2024 Gartner® Magic Quadrant™ nomeou a Netskope como líder em Security Service Edge pelo terceiro ano consecutivo.

- Por que Netskope

Nossos clientes

A Netskope atende a mais de 3.000 clientes em todo o mundo, incluindo mais de 25 das empresas da Fortune 100

Veja nossos clientesAjudamos nossos clientes a estarem prontos para tudo - Por que Netskope

Nossos parceiros

Fazemos parceria com líderes de segurança para ajudá-lo a proteger sua jornada para a nuvem.

Saiba mais sobre os parceiros da NetskopeA estratégia de comercialização da Netskope, focada em Parcerias, permite que nossos Parceiros maximizem seu crescimento e lucratividade enquanto transformam a segurança corporativa.

-

Plataforma

- Plataforma

Netskope One Platform

O Netskope One é uma plataforma convergente de segurança e rede como serviço.

Receba o whitepaperSua Rede do AmanhãPlaneje seu caminho rumo a uma rede mais rápida, segura e resiliente projetada para os aplicativos e usuários aos quais você oferece suporte.

- Plataforma

Recursos da plataforma Netskope One

O Netskope One aumenta a agilidade dos negócios com a velocidade da luz e a resiliência confiável.

Saiba mais sobre o Netskope OneApresentando a plataforma Netskope OneO Netskope One é uma plataforma nativa da nuvem que oferece serviços convergentes de segurança e rede para permitir sua transformação SASE e zero trust.

- Plataforma

NewEdge

A NewEdge é a maior nuvem privada de segurança de alto desempenho do mundo.

Conheça a NewEdgeAdote uma arquitetura Secure Access Service Edge (SASE)O Netskope NewEdge é a maior nuvem privada de segurança de alto desempenho do mundo e oferece aos clientes cobertura de serviço, desempenho e resiliência inigualáveis.

- Plataforma

Parceiros tecnológicos e integrações

A Netskope faz parceria com as empresas mais fortes em tecnologia empresarial.

Saiba mais sobre o Cloud ExchangeNetskope Cloud ExchangeO Cloud Exchange (CE) da Netskope oferece aos clientes ferramentas de integração poderosas para tirar proveito dos investimentos em estratégias de segurança.

-

Produtos

- Produtos

Produtos de Serviço de Segurança Edge

Proteger-se contra ameaças avançadas e com nuvens e salvaguardar os dados em todos os vetores.

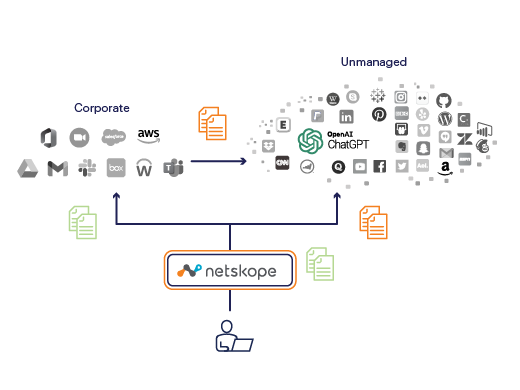

Vá para a plataformaA plataforma do futuro é a NetskopeIntelligent Security Service Edge (SSE), Cloud Access Security Broker (CASB), Cloud Firewall, Next Generation Secure Web Gateway (SWG) e Private Access for ZTNA integrados nativamente em uma única solução para ajudar todas as empresas em sua jornada para o Secure Access Service Arquitetura de borda (SASE).

- Security Service Edge (SSE)

- Next Gen Secure Web Gateway (SWG)

- Cloud Access Security Broker (CASB)

- ZTNA Next

- SkopeAI

- Segurança de Nuvem Pública

- Advanced Analytics

- Firewall de nuvem

- Prevenção contra a perda de dados (Data Loss Prevention - DLP)

- Digital Experience Management

- Inteligência do dispositivo

- Isolamento remoto do navegador

- Gerenciamento da postura de segurança do SaaS

- Security Service Edge (SSE)

- Produtos

Borderless SD-WAN

Confidentemente, proporcionar acesso seguro e de alto desempenho a cada usuário remoto, dispositivo, site, e nuvem.

Saiba mais sobre Next Gen SASE BranchNext Gen SASE Branch é híbrida — conectada, segura e automatizadaNetskope Next Gen SASE Branch converge o Context-Aware SASE Fabric, Zero-Trust Hybrid Security e SkopeAI-Powered Cloud Orchestrator em uma oferta de nuvem unificada, inaugurando uma experiência de filial totalmente modernizada para empresas sem fronteiras.

- Borderless SD-WAN

- Filial SASE de próxima geração

- SD-WAN seguro

- Endpoint SD-WAN

- Micro Branch

- WAN sem fio

- Multi-cloud Networking

- Acesso Inteligente IoT

- Borderless SD-WAN

- Produtos

Secure Access Service Edge

O Netskope One SASE oferece uma solução SASE nativa da nuvem, totalmente convergente e de fornecedor único.

Baixe o eBookDesenvolvendo uma Arquitetura SASE para LeigosObtenha sua cópia gratuita do único guia de planejamento SASE que você realmente precisará.

-

Soluções

- Soluções

Transformação da rede

Obtenha agilidade e eficiência por meio da transformação digital.

Vá para das soluçõesConheça a NewEdgeMude para serviços de segurança na nuvem líderes de mercado com latência mínima e alta confiabilidade. - Soluções

Modernização da segurança

Enfrente os desafios de segurança de hoje e de amanhã.

Saiba como protegemos o uso de IA generativaPermita com segurança o uso de aplicativos generativos de IA com controle de acesso a aplicativos, treinamento de usuários em tempo real e a melhor proteção de dados da categoria.- Advanced Threat Protection

- Proteção de dados

- Trabalho Híbrido

- Riscos internos

- Mantenha a conformidade com a nuvem

- Substituir VPNs

- Ative com segurança o ChatGPT e a IA generativa

- Proteção de Aplicações Gerenciadas na Nuvem

- Proteção de Aplicações Não Gerenciadas na Nuvem

- AWS, Azure & GCP

- Advanced Threat Protection

- Soluções

Estruturas

Abrace as estruturas regulatórias que moldam a segurança cibernética.

Vá para das soluçõesConheça o Zero TrustSoluções de zero trust para a implementação de SSE e SASE - Soluções

Governo e indústrias

A Netskope ajuda as maiores agências e empresas do mundo a proteger sua jornada para a nuvem.

Saiba mais sobre o Netskope GovCloudNetskope obtém alta autorização do FedRAMPEscolha o Netskope GovCloud para acelerar a transformação de sua agência.

- Finanças e Seguradoras

- Saúde e Ciência

- Tecnologia de Ponta

- Instituições de Ensino Superior

- Ensino Fundamental e Médio

- Judiciário

- Manufatura

- Setor público

- Varejo e Hospedagem

- Serviços

- Utilities

- Finanças e Seguradoras

-

Recursos

- Recursos

Recursos

Saiba mais sobre como a Netskope pode ajudá-lo a proteger sua jornada para a nuvem.

Reproduzir o podcastPodcast Security VisionariesHow to Use a Magic Quadrant and Other Industry Research

Neste episódio, Max Havey, Steve Riley e Mona Faulkner analisam o intrincado processo de criação de um Magic Quadrant e por que ele é muito mais do que apenas um gráfico. - Recursos

Blog

Saiba como a Netskope permite a transformação da segurança e da rede por meio do SSE (Security Service Edge)

Leia o BlogÚltimos blogsLeia como a Netskope pode viabilizar a jornada Zero Trust e SASE por meio de recursos de borda de serviço de segurança (SSE).

- Recursos

Eventos e workshops

Esteja atualizado sobre as últimas tendências de segurança e conecte-se com seus pares.

Explorar sessõesSASE Week 2023: Sua jornada SASE começa agora!Replay das sessões da quarta SASE Week anual.

- Recursos

Security Defined

Tudo o que você precisa saber em nossa enciclopédia de segurança cibernética.

Saiba mais sobre o Security Service EdgeO que é o Security Service Edge?Explore o lado de segurança de SASE, o futuro da rede e proteção na nuvem.

- Visão geral de segurança definida

- O que é SASE?

- O que é o Security Service Edge?

- O que é um Cloud Access Security Broker?

- O que é Segurança Zero Trust?

- O que é um Next Generation Secure Web Gateway (SWG)?

- O que é a Prevenção contra Perda de Dados (DLP)?

- O que é SD-WAN?

- O que é IA generativa?

- O que é Isolamento de Navegador Remoto?

- O que é SSPM?

- O que é FedRamp?

- Visão geral de segurança definida

-

Empresa

- Empresa

Empresa

Ajudamos você a antecipar os desafios da nuvem, dos dados e da segurança da rede.

Saiba maisApoiando a sustentabilidade por meio da segurança de dadosA Netskope tem o orgulho de participar da Visão 2045: uma iniciativa destinada a aumentar a conscientização sobre o papel da indústria privada na sustentabilidade.

- Empresa

Liderança

Nossa equipe de liderança está fortemente comprometida em fazer tudo o que for preciso para tornar nossos clientes bem-sucedidos.

Conheça nossa equipePensadores, construtores, sonhadores, inovadores. Juntos, fornecemos soluções de segurança na nuvem de última geração para ajudar nossos clientes a proteger seus dados e seu pessoal. - Empresa

Customer Solutions

Estamos aqui junto com você a cada passo da sua trajetória, assegurando seu sucesso com a Netskope.

Conheça os Serviços ProfissionaisA talentosa e experiente equipe de Serviços Profissionais da Netskope fornece uma abordagem prescritiva para sua implementação bem sucedida.- Serviços Profissionais

- Customer Success

- Apoio técnico

- Parceiros de prestação de serviços

- Customer Community

- Documentação do produto

- Portal de Suporte

- Trust Portal

- Serviços Profissionais

- Empresa

Treinamento e certificação

Os treinamentos da Netskope vão ajudar você a ser um especialista em segurança na nuvem.

Saiba mais sobre Treinamentos e CertificaçõesProteja sua jornada de transformação digital e aproveite ao máximo seus aplicativos de nuvem, web e privados com o treinamento da Netskope.- Netskope Security Cloud Introductory Online Technical Training

- Netskope Security Cloud Operation and Administration (NSCO&A)

- Netskope Security Cloud Implementation and Integration (NSCI&I)

- Programa de certificação da plataforma Netskope Cloud Security

- Netskope Security Cloud Introductory Online Technical Training

- Por que Netskope

Mudando a forma como a rede e a segurança trabalham juntas.

- Nossos clientes

A Netskope atende a mais de 3.000 clientes em todo o mundo, incluindo mais de 25 das empresas da Fortune 100

- Nossos parceiros

Fazemos parceria com líderes de segurança para ajudá-lo a proteger sua jornada para a nuvem.

Ainda mais longe na visão.

Saiba por que o 2024 Gartner® Magic Quadrant™ nomeou a Netskope como líder em Security Service Edge pelo terceiro ano consecutivo.

Obtenha o Relatório

- Netskope One Platform

O Netskope One é uma plataforma convergente de segurança e rede como serviço.

- Recursos da plataforma Netskope One

O Netskope One aumenta a agilidade dos negócios com a velocidade da luz e a resiliência confiável.

- NewEdge

A NewEdge é a maior nuvem privada de segurança de alto desempenho do mundo.

- Parceiros tecnológicos e integrações

A Netskope faz parceria com as empresas mais fortes em tecnologia empresarial.

Planeje seu caminho rumo a uma rede mais rápida, segura e resiliente projetada para os aplicativos e usuários aos quais você oferece suporte.

Receba o whitepaper

O Netskope One é uma plataforma nativa da nuvem que oferece serviços convergentes de segurança e rede para permitir sua transformação SASE e zero trust.

Saiba mais sobre o Netskope One

O Netskope NewEdge é a maior nuvem privada de segurança de alto desempenho do mundo e oferece aos clientes cobertura de serviço, desempenho e resiliência inigualáveis.

Conheça a NewEdge

O Cloud Exchange (CE) da Netskope oferece aos clientes ferramentas de integração poderosas para tirar proveito dos investimentos em estratégias de segurança.

Saiba mais sobre o Cloud Exchange

- Produtos de Serviço de Segurança Edge

Proteger-se contra ameaças avançadas e com nuvens e salvaguardar os dados em todos os vetores.

- Borderless SD-WAN

Confidentemente, proporcionar acesso seguro e de alto desempenho a cada usuário remoto, dispositivo, site, e nuvem.

- Secure Access Service Edge

O Netskope One SASE oferece uma solução SASE nativa da nuvem, totalmente convergente e de fornecedor único.

- Security Service Edge (SSE)

- Next Gen Secure Web Gateway (SWG)

- Cloud Access Security Broker (CASB)

- ZTNA Next

- SkopeAI

- Segurança de Nuvem Pública

- Advanced Analytics

- Firewall de nuvem

- Prevenção contra a perda de dados (Data Loss Prevention - DLP)

- Digital Experience Management

- Inteligência do dispositivo

- Isolamento remoto do navegador

- Gerenciamento da postura de segurança do SaaS

Intelligent Security Service Edge (SSE), Cloud Access Security Broker (CASB), Cloud Firewall, Next Generation Secure Web Gateway (SWG) e Private Access for ZTNA integrados nativamente em uma única solução para ajudar todas as empresas em sua jornada para o Secure Access Service Arquitetura de borda (SASE).

Vá para a plataforma

Netskope Next Gen SASE Branch converge o Context-Aware SASE Fabric, Zero-Trust Hybrid Security e SkopeAI-Powered Cloud Orchestrator em uma oferta de nuvem unificada, inaugurando uma experiência de filial totalmente modernizada para empresas sem fronteiras.

Saiba mais sobre Next Gen SASE Branch

Obtenha sua cópia gratuita do único guia de planejamento SASE que você realmente precisará.

Baixe o eBook

- Transformação da rede

Obtenha agilidade e eficiência por meio da transformação digital.

- Modernização da segurança

Enfrente os desafios de segurança de hoje e de amanhã.

- Estruturas

Abrace as estruturas regulatórias que moldam a segurança cibernética.

- Governo e indústrias

A Netskope ajuda as maiores agências e empresas do mundo a proteger sua jornada para a nuvem.

- Advanced Threat Protection

- Proteção de dados

- Trabalho Híbrido

- Riscos internos

- Mantenha a conformidade com a nuvem

- Substituir VPNs

- Ative com segurança o ChatGPT e a IA generativa

- Proteção de Aplicações Gerenciadas na Nuvem

- Proteção de Aplicações Não Gerenciadas na Nuvem

- AWS, Azure & GCP

Escolha o Netskope GovCloud para acelerar a transformação de sua agência.

Saiba mais sobre o Netskope GovCloud

- Recursos

Saiba mais sobre como a Netskope pode ajudá-lo a proteger sua jornada para a nuvem.

- Blog

Saiba como a Netskope permite a transformação da segurança e da rede por meio do SSE (Security Service Edge)

- Eventos e workshops

Esteja atualizado sobre as últimas tendências de segurança e conecte-se com seus pares.

- Security Defined

Tudo o que você precisa saber em nossa enciclopédia de segurança cibernética.

- Visão geral de segurança definida

- O que é SASE?

- O que é o Security Service Edge?

- O que é um Cloud Access Security Broker?

- O que é Segurança Zero Trust?

- O que é um Next Generation Secure Web Gateway (SWG)?

- O que é a Prevenção contra Perda de Dados (DLP)?

- O que é SD-WAN?

- O que é IA generativa?

- O que é Isolamento de Navegador Remoto?

- O que é SSPM?

- O que é FedRamp?

How to Use a Magic Quadrant and Other Industry Research

Neste episódio, Max Havey, Steve Riley e Mona Faulkner analisam o intrincado processo de criação de um Magic Quadrant e por que ele é muito mais do que apenas um gráfico.

Leia como a Netskope pode viabilizar a jornada Zero Trust e SASE por meio de recursos de borda de serviço de segurança (SSE).

Leia o Blog

Replay das sessões da quarta SASE Week anual.

Explorar sessões

Explore o lado de segurança de SASE, o futuro da rede e proteção na nuvem.

Saiba mais sobre o Security Service Edge

- Empresa

Ajudamos você a antecipar os desafios da nuvem, dos dados e da segurança da rede.

- Liderança

Nossa equipe de liderança está fortemente comprometida em fazer tudo o que for preciso para tornar nossos clientes bem-sucedidos.

- Customer Solutions

Estamos aqui junto com você a cada passo da sua trajetória, assegurando seu sucesso com a Netskope.

- Treinamento e certificação

Os treinamentos da Netskope vão ajudar você a ser um especialista em segurança na nuvem.

A Netskope tem o orgulho de participar da Visão 2045: uma iniciativa destinada a aumentar a conscientização sobre o papel da indústria privada na sustentabilidade.

Saiba mais

)

)

Leia o Blog

Leia o Blog