El ritmo de la innovación en la IA generativa ha sido nada menos que explosivo. Lo que comenzó con los usuarios experimentando con aplicaciones públicas como ChatGPT ha evolucionado rápidamente hasta convertirse en una adopción generalizada por parte de las empresas. Las funciones de IA ahora están perfectamente integradas en herramientas empresariales cotidianas, como plataformas de atención al cliente como Gladly, software de recursos humanos como Lattice e incluso redes sociales como LinkedIn.

Mientras tanto, muchas organizaciones están dando un paso más allá y creando sus propias aplicaciones de IA, basadas en modelos de acceso abierto, como DeepSeek y LLaMA, y respaldadas por comunidades como Hugging Face, que permiten compartir modelos y datos sin problemas. Durante el último año, el número de organizaciones que utilizan infraestructura de IA generativa local se ha disparado, pasando de menos del 1 % a más del 50 %.

Pero a medida que se acelera la innovación, también lo hacen los riesgos. Ya estamos familiarizados con la TI en la sombra y la pérdida de datos como principales preocupaciones en el uso de aplicaciones de IA generativa públicas. Netskope Threat Labs informa de que la TI en la sombra impulsa el 72 % del uso de aplicaciones de IA generativa, lo que a menudo implica la carga de datos confidenciales, como código fuente, información regulada y propiedad intelectual. Y aunque solo el 5 % de los usuarios interactúa directamente con aplicaciones de IA generativa independientes, más del 75 % usa herramientas empresariales con capacidades de IA generativa integradas. Con la incorporación de organizaciones que ahora implementan modelos locales, el panorama de riesgos sigue evolucionando y presenta nuevos retos en torno al acceso a los datos, la gobernanza de los modelos y la supervisión operativa.

Este momento representa algo más que un cambio en la productividad; es un punto de inflexión para los responsables de la seguridad. La cuestión no es si se adoptará la IA, sino cómo se protegerá su adopción.

Tome el control de su viaje de IA con Netskope One

Gestionar el riesgo de la IA hoy en día significa comprender la evolución del panorama de la IA y aplicar políticas detalladas que protejan todo su ecosistema de IA de extremo a extremo, en todas partes. Netskope One ofrece un conjunto de capacidades de servicios de seguridad perimetral (SSE) de Netskope, líderes en el sector, para proteger a los usuarios, los agentes, los datos y las aplicaciones en toda su empresa.

Con la plataforma Netskope One, que cuenta con la tecnología de toda la gama de innovaciones de SkopeAI, no solo protege su transición a la IA, sino que la domina. Así es como funciona:

Logre la preparación para la IA con una comprensión proactiva de sus datos y aplicaciones

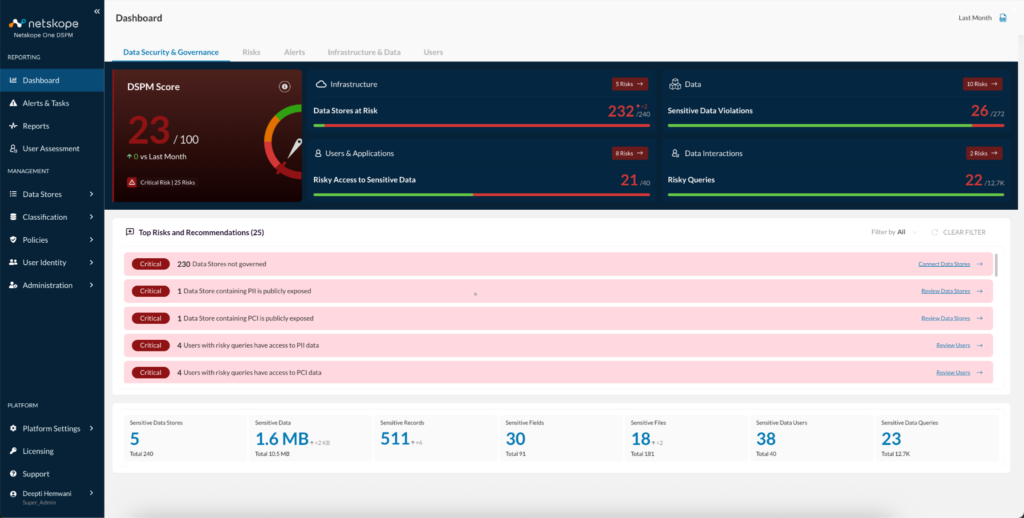

Lograr una verdadera preparación para la IA comienza con una comprensión proactiva de sus datos y aplicaciones. Con la DSPM de Netskope, su organización puede detectar, clasificar y etiquetar automáticamente datos estructurados y no estructurados en diversos almacenes de datos, como AWS S3, GCP BigQuery, Azure Blob Storage y PostgreSQL. Esta visibilidad permite a los equipos establecer políticas de exposición de datos antes de que los modelos de IA entren en contacto con contenido confidencial, lo que evita que los datos confidenciales se usen para entrenar LLM públicos o privados. Por ejemplo, una empresa de servicios financieros puede garantizar que sus herramientas de IA generativa empresarial no se entrenen con datos financieros altamente confidenciales, evitando así una exposición involuntaria. Este tipo de previsión y control es lo que permite a las organizaciones estar realmente preparadas para la IA.

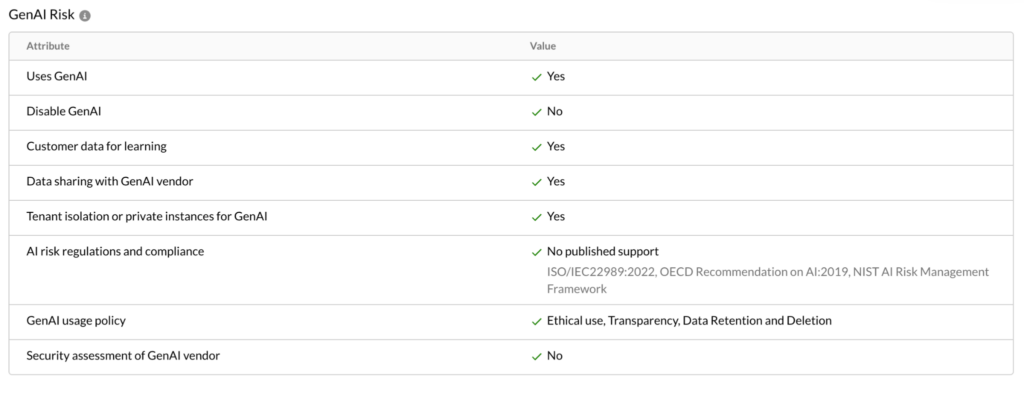

Para obtener una visión profunda de sus aplicaciones, el Cloud Confidence Index (CCI) de Netskope proporciona un contexto detallado sobre los riesgos, lo que permite a los equipos tomar decisiones informadas sobre qué aplicaciones habilitadas para IA permitir, restringir o bloquear. Esto resulta especialmente importante a la hora de proteger la propiedad intelectual, el código fuente o los datos regulados. Netskope identifica y clasifica los riesgos de más de 82 000 aplicaciones públicas. Tanto si se trata de una herramienta de IA generativa dedicada como de una aplicación SaaS tradicional mejorada con funciones de IA generativa, Netskope One le proporciona información detallada sobre las características de los riesgos, incluyendo si usan datos de clientes para el entrenamiento, si comparten datos con terceros, si cumplen requisitos de cumplimiento normativo específicos y mucho más, para ayudarle a tomar decisiones informadas sobre su uso en su entorno.

Obtenga visibilidad completa de su panorama de IA

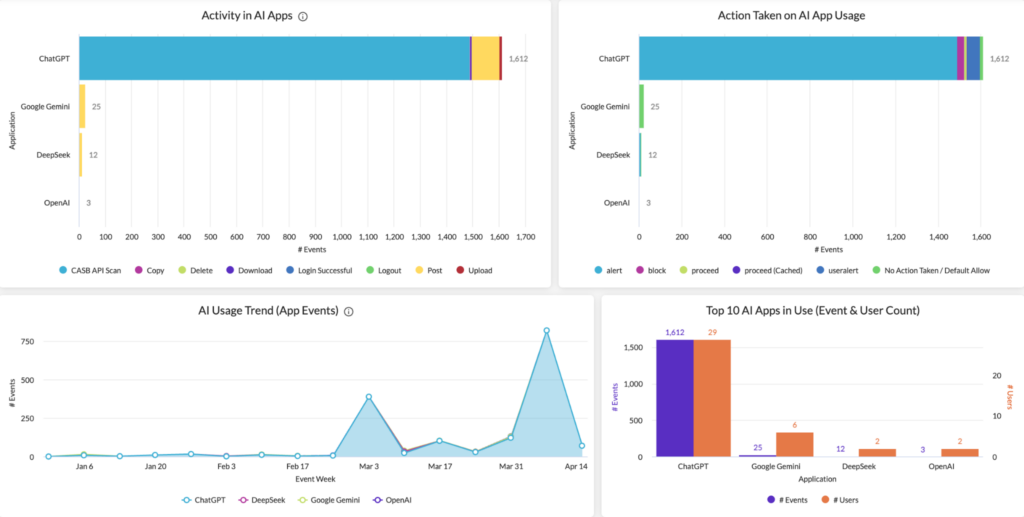

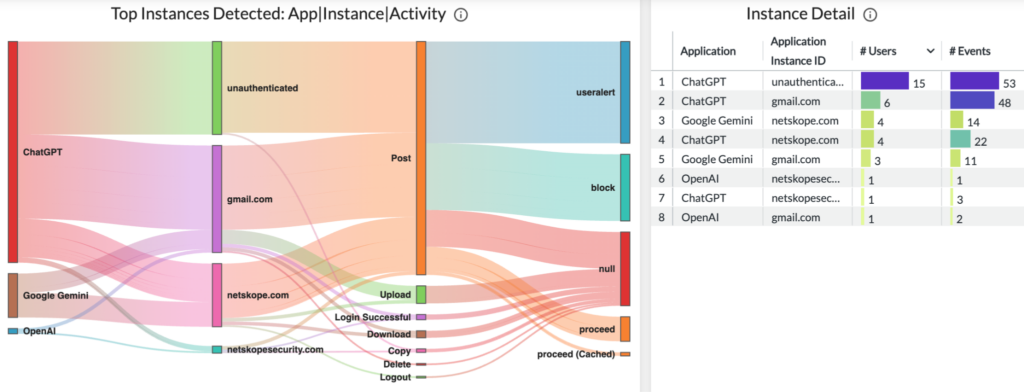

La visibilidad es la base para una adopción responsable de la IA. A medida que los equipos de seguridad establecen y evalúan continuamente sus políticas de IA, necesitan comprender cómo interactúan los usuarios con la IA y qué herramientas se están usando. Con Netskope One, sus iniciativas de IA se ven reforzadas por el contexto completo de las interacciones de la IA dentro de su organización. La plataforma Netskope One proporciona una visibilidad completa de las aplicaciones SaaS de IA generativa gestionadas y no gestionadas, lo que le ayuda a abordar el reto de la TI en la sombra. En el panel de control de la IA, puede ver las tendencias de la actividad de la IA, las aplicaciones de IA más usadas, las acciones realizadas dentro de esas aplicaciones y mucho más.

Tanto si supervisa el acceso del personal a modelos de IA generativa como si identifica fugas de datos entre aplicaciones de IA generativa personales y corporativas, la visibilidad detallada de Netskope le permite gestionar los riesgos de forma proactiva. Con esta información detallada, puede ir más allá de la confianza ciega y obtener un control estratégico sobre sus actividades de IA, lo que garantiza una implementación segura de la IA en toda su organización.

Aplique protección contextual y proteja a todos los usuarios y agentes, en todas partes

En el mundo de la IA, que evoluciona rápidamente, la seguridad debe ser dinámica y adaptable. Con información contextual completa procedente de evaluaciones de riesgos, protecciones integradas y basadas en API, y comprobaciones de la estrategia, las políticas de seguridad unificadas de Netskope controlan a la perfección las interacciones de los usuarios (y pronto también de los agentes), lo que permite un control preciso y detallado. Gracias a sus capacidades avanzadas de prevención de pérdida de datos (DLP), Netskope ayuda a proteger la información confidencial contra la filtración a través de aplicaciones SaaS públicas como ChatGPT, Microsoft Copilot y Google Gemini. Esto significa impedir el acceso no autorizado a los datos, supervisar las interacciones de la IA para garantizar el cumplimiento de las políticas y detectar y mitigar las amenazas emergentes en tiempo real. Mientras que muchos proveedores se centran únicamente en proteger el acceso de los usuarios a las herramientas de IA, Netskope va un paso más allá al ofrecer visibilidad y protección durante todo el ciclo de vida de la IA, incluyendo cómo se utilizan, comparten y se aprende de los datos. Ya se trate de proteger herramientas de colaboración mejoradas con IA o de proteger los datos que fluyen a través de un LLM privado, Netskope ofrece la protección más amplia disponible para las aplicaciones y los datos empresariales, desde las nubes públicas hasta los entornos privados.

Próximos pasos

Para obtener más información sobre cómo Netskope One proporciona la visibilidad y el control necesarios para proteger todo su ecosistema de IA, visite nuestra página Protección de la IA.

Atrás

Atrás

Lea el blog

Lea el blog