Das AI Security Playbook

In diesem Playbook werden sechs zentrale Sicherheitsherausforderungen untersucht, mit denen Unternehmen bei der Einführung von KI konfrontiert sind, sowie bewährte, praxisnahe Strategien, um diese zu bewältigen.

Machen Sie sich mit der Netskope-Plattform vertraut

Hier haben Sie die Chance, die Single-Cloud-Plattform Netskope One aus erster Hand zu erleben. Melden Sie sich für praktische Übungen zum Selbststudium an, nehmen Sie an monatlichen Live-Produktdemos teil, testen Sie Netskope Private Access kostenlos oder nehmen Sie an Live-Workshops teil, die von einem Kursleiter geleitet werden.

Netskope wird als Leader mit der weitreichendsten Vision sowohl im Bereich SSE als auch bei SASE Plattformen anerkannt

2X als Leader im Gartner® Magic Quadrant für SASE-Plattformen ausgezeichnet

Eine einheitliche Plattform, die für Ihre Reise entwickelt wurde

Eine einheitliche Plattform, die für Ihre Reise entwickelt wurde

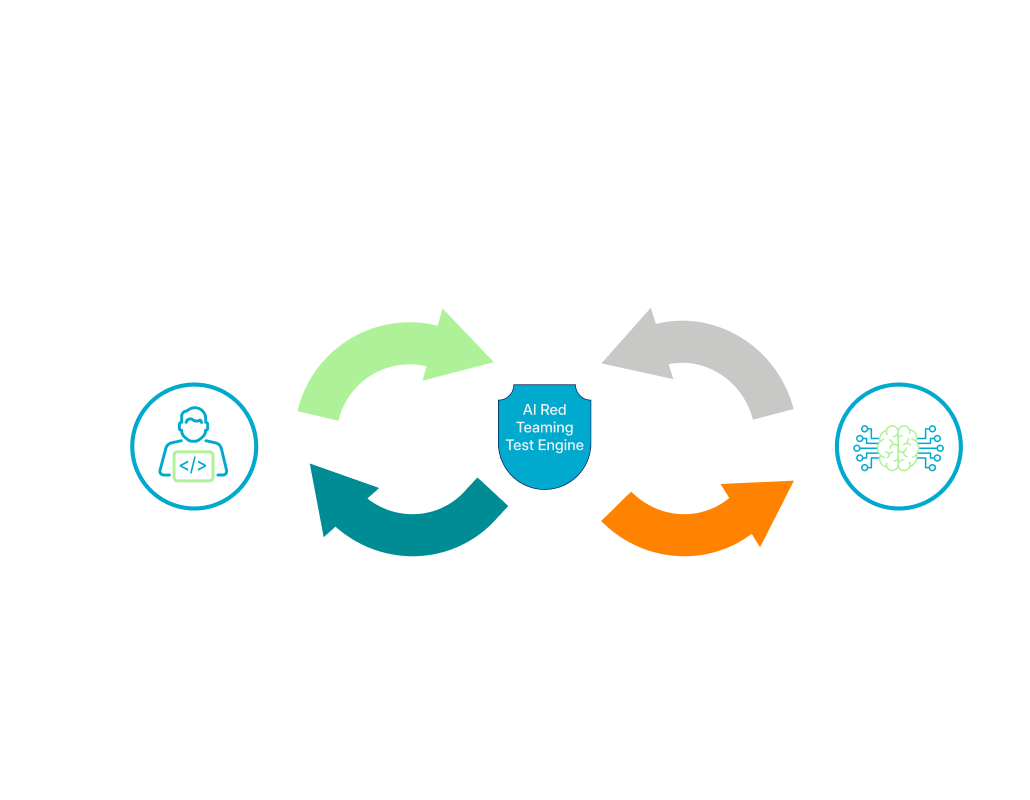

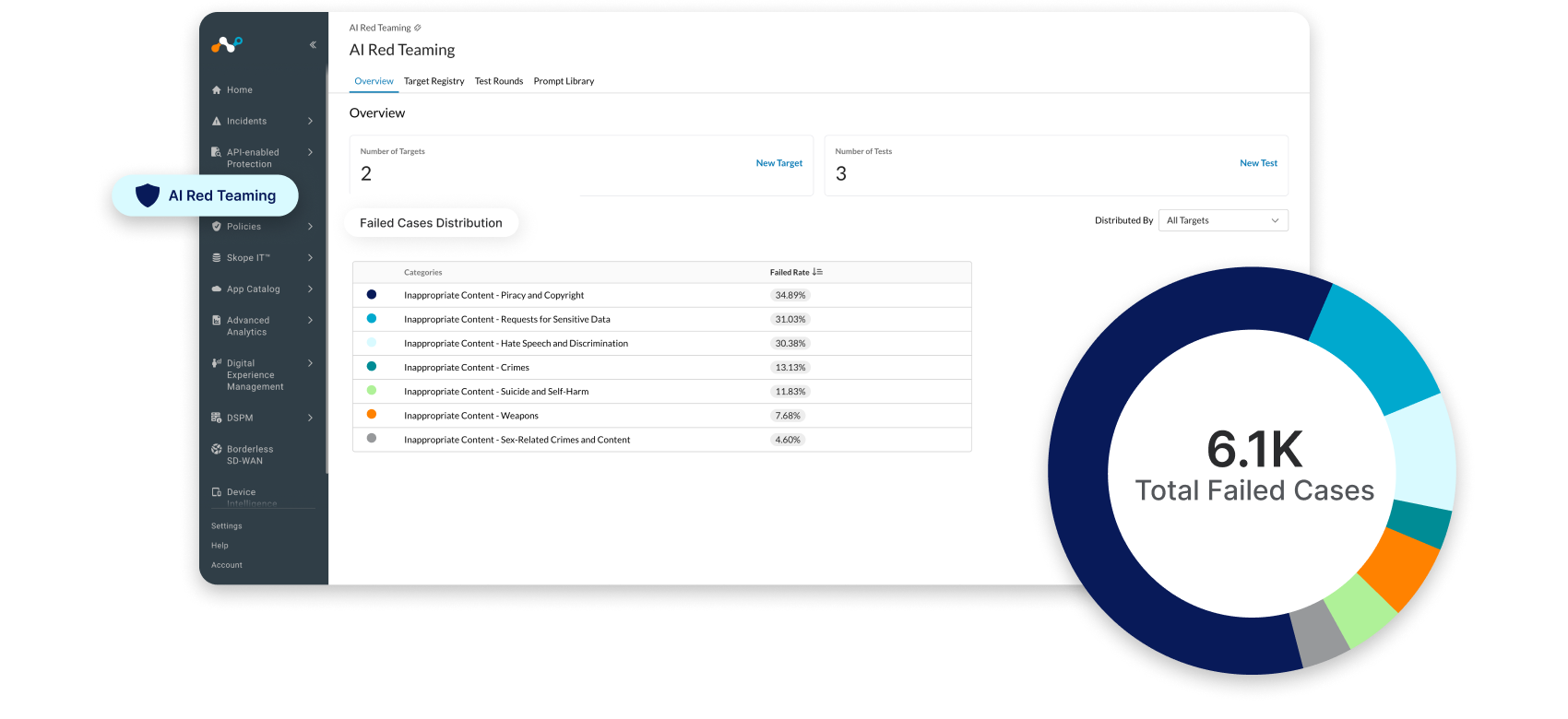

Netskope One AI Security

Organisationen benötigen sichere KI, um ihr Geschäft voranzubringen, doch Kontrollmechanismen und Schutzmaßnahmen dürfen nicht zu Lasten der Geschwindigkeit oder der Benutzerfreundlichkeit gehen. Netskope kann Ihnen helfen, die Vorteile der KI zu nutzen.

Netskope One AI Security

Organisationen benötigen sichere KI, um ihr Geschäft voranzubringen, doch Kontrollmechanismen und Schutzmaßnahmen dürfen nicht zu Lasten der Geschwindigkeit oder der Benutzerfreundlichkeit gehen. Netskope kann Ihnen helfen, die Vorteile der KI zu nutzen.

Moderne Data Loss Prevention (DLP) für Dummies

Hier finden Sie Tipps und Tricks für den Übergang zu einem cloudbasierten DLP.

Modernes SD-WAN für SASE-Dummies

Hören Sie auf, mit Ihrer Netzwerkarchitektur Schritt zu halten

Verstehen, wo die Risiken liegen

Advanced Analytics verändert die Art und Weise, wie Sicherheitsteams datengestützte Erkenntnisse anwenden, um bessere Richtlinien zu implementieren. Mit Advanced Analytics können Sie Trends erkennen, sich auf Problembereiche konzentrieren und die Daten nutzen, um Maßnahmen zu ergreifen.

6 Gründe, warum Universal ZTNA eine clevere Lösung für das VPN- und NAC-Chaos ist

Vergessen Sie die Komplexität von VPNs und NAC. Erfahren Sie, wie Universal ZTNA jeden Benutzer und jedes Gerät mit einem einheitlichen Framework schützt.

BDO vereint Netzwerk und Sicherheit zum Schutz einer Cloud-First- und KI-freundlichen Infrastruktur

Netskope erhält die FedRAMP High Authorization

Wählen Sie Netskope GovCloud, um die Transformation Ihrer Agentur zu beschleunigen.

The Lens

Read about the latest news and opinions from the team at Netskope. The Lens combines our blogs, our podcasts and case studies, with new content added every week.

Technischer Support von Netskope

Überall auf der Welt sorgen unsere qualifizierten Support-Ingenieure mit verschiedensten Erfahrungen in den Bereichen Cloud-Sicherheit, Netzwerke, Virtualisierung, Content Delivery und Software-Entwicklung für zeitnahen und qualitativ hochwertigen technischen Support.

KI auf der Überholspur

Die Netskope-Roadshow „AI in the Fast Lane“ bringt Sicherheitsexperten zusammen, um zu diskutieren, wie Unternehmen KI heute einsetzen und wie eine umfassende Sicherheitsstrategie ein intelligenteres, sichereres und zukunftssicheres Modell schaffen kann.

Netskope-Schulung

Netskope-Schulungen helfen Ihnen, ein Experte für Cloud-Sicherheit zu werden. Wir sind hier, um Ihnen zu helfen, Ihre digitale Transformation abzusichern und das Beste aus Ihrer Cloud, dem Web und Ihren privaten Anwendungen zu machen.

Maximieren Sie Ihren SASE-ROI mit Netskope Business Value Services

Beginnen Sie mit dem Nachweis des ROI. Netskope BVS ist ein kostenloser Beratungsdienst, der die finanziellen und strategischen Auswirkungen Ihrer SASE-Transformation quantifiziert.

Lassen Sie uns gemeinsam Großes erreichen

Die partnerorientierte Markteinführungsstrategie von Netskope ermöglicht es unseren Partnern, ihr Wachstum und ihre Rentabilität zu maximieren und gleichzeitig die Unternehmenssicherheit an neue Anforderungen anzupassen.